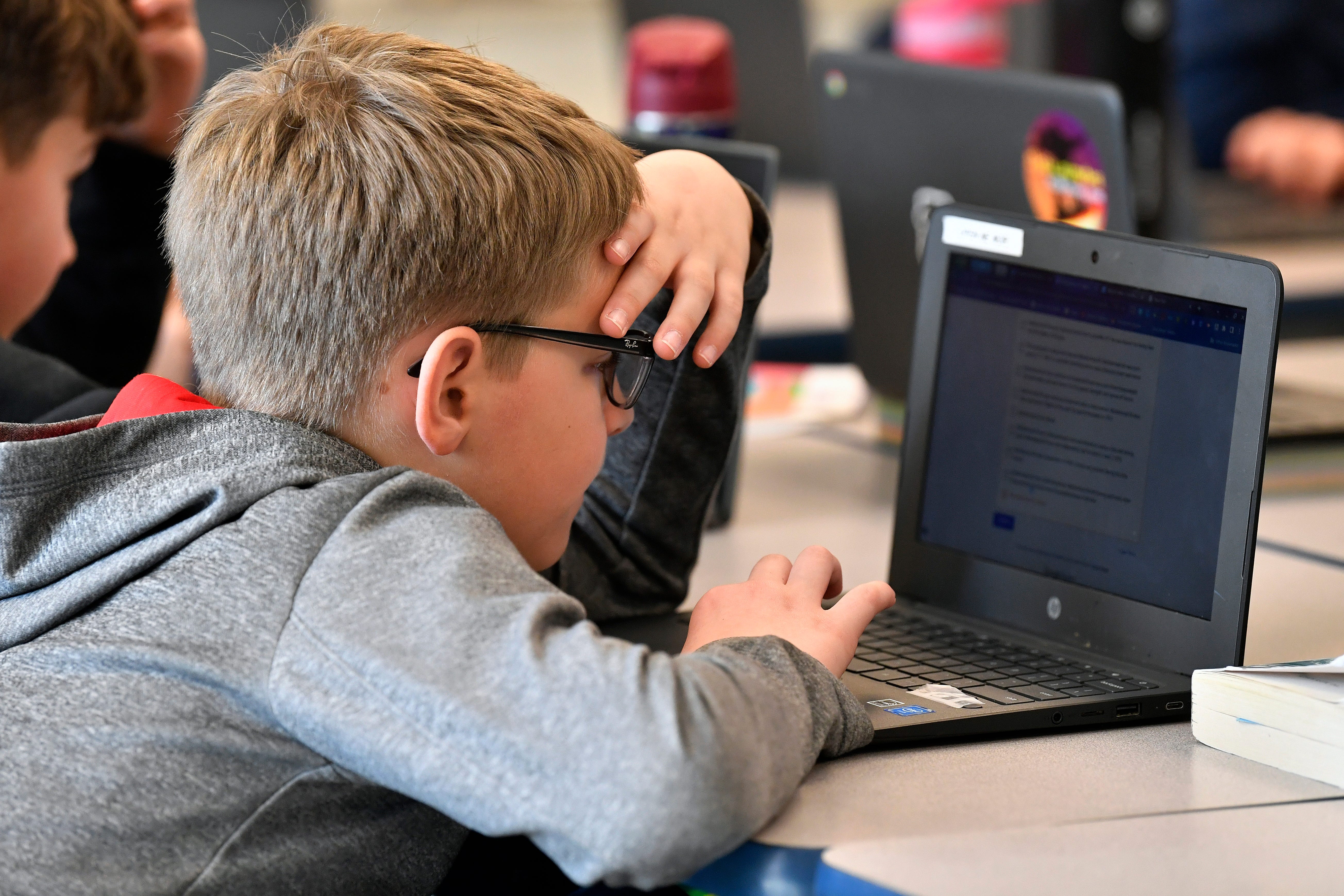

ChatGPT adopté par les élèves de CM2 du Kentucky qui apprennent à utiliser la technologie

ChatGPT a fait craindre que les étudiants utilisent le chatbot alimenté par l’IA pour rédiger leurs essais et tricher sur les devoirs. Mais certains enseignants disent que cela devient rapidement un outil dont leurs élèves auront besoin à l’avenir. (14 février) (Vidéo AP : Dylan Lovan)

ap

L’incroyable capacité de ChatGPT à répondre aux questions des gens avec des réponses générées instantanément et faciles à comprendre pourrait changer la donne pour les personnes cherchant des conseils médicaux, mais un nouvel essai dans une revue médicale indique que ce n’est pas si simple. Et aussi ChatGPT.

Peter Lee, vice-président de Microsoft, a passé les six derniers mois à expérimenter la dernière édition de ChatGPT, une plateforme d’intelligence artificielle conçue pour répondre aux questions des utilisateurs sur un ton conversationnel.

Comme d’autres soi-disant grands modèles de langage, ChatGPT, construit par la startup OpenAI basée à San Francisco, est formé sur des quantités massives de données disponibles sur Internet, dans des livres et à partir d’autres sources. Il utilise des algorithmes pour générer des mots séquentiels en fonction de la fréquence à laquelle ils apparaissent ensemble en ligne. Le moteur de recherche Bing de Microsoft utilise désormais ChatGPT.

Lee, un informaticien qui dirige la recherche Microsoft dans le monde entier, s’intéresse particulièrement au potentiel médical et scientifique de ChatGPT.

PRÉCÉDEMMENT: ChatGPT est prêt à bouleverser les informations médicales. Pour le meilleur ou pour le pire.

Il a publié un essai jeudi dans le New England Journal of Medicine sur les utilisations potentielles de ChatGPT pour enregistrer des notes médicales, offrir des possibilités de diagnostic, éduquer les médecins et les patients, et analyser et résumer les données. La capacité de l’interface à fournir des réponses humaines et empathiques est particulièrement remarquable, a-t-il déclaré.

Nous avons interrogé Lee, également co-auteur du livre à paraître « The AI Revolution in Medicine: GPT-4 and Beyond », sur son enthousiasme et ses inquiétudes concernant la dernière version de ChatGPT, désormais ChatGPT-4, qui vient d’être publiée. . Nous avons également posé les mêmes questions à ChatGPT, mais comme sa disponibilité est encore limitée, les réponses proviennent de ChatGPT-3.

Question : ChatGPT fournit-il des informations médicales fiables ?

Li : Personnellement, je ne ferais pas confiance à des modèles à ce niveau de sophistication pour mes conseils ou informations personnels sur la santé, et je serais inquiet si les médecins et les infirmières les prendraient pour la prise de décision médicale.

Chats GPT : ChatGPT est un modèle de langage entraîné sur de grandes quantités de données textuelles, y compris des informations médicales. Cependant, il est important de noter que ChatGPT n’est pas un professionnel de la santé et que leurs réponses ne doivent pas être considérées comme des conseils médicaux.

Bien que ChatGPT puisse fournir des informations sur des sujets médicaux, il est essentiel que vous vérifiiez ces informations auprès d’un professionnel de la santé qualifié avant de prendre toute décision concernant votre santé. Il existe également un risque que ChatGPT fournisse des informations médicales inexactes ou obsolètes, ce qui pourrait être potentiellement dangereux.

Question : Quel type d’erreurs ChatGPT commet généralement et pourquoi ?

Li : Les modèles GPT sont généralement mauvais pour récupérer des informations. C’est presque par conception, car les modèles GPT ne veulent pas régurgiter les données d’entraînement. Si vous demandez une source spécifique, telle qu’une référence de document, il est incapable de ressusciter la source exacte, alors il invente quelque chose, « hallucine ».

Chats GPT : ChatGPT peut faire des erreurs telles que fournir des réponses non pertinentes ou incorrectes, se répéter ou produire des réponses qui ne correspondent pas au contexte de la conversation.

Ces erreurs peuvent se produire car ChatGPT est formé sur de grandes quantités de données textuelles, y compris des informations non vérifiées et potentiellement biaisées, ce qui peut conduire à des informations incorrectes ou obsolètes.

De plus, les réponses de ChatGPT peuvent être affectées par la qualité de l’entrée qu’il reçoit, ce qui peut entraîner des réponses non pertinentes ou hors sujet.

Question : En quoi ChatGPT-4 est-il meilleur que ChatGPT-3 ?

Li : Nous arrivons à un autre niveau d’intelligence. L’essentiel est que vous disposiez de ce modèle d’IA doté de nombreuses capacités cognitives et d’une interface de chat. Il finit par être vraiment naturel d’interagir avec.

Chats GPT : Il est raisonnable de s’attendre à des améliorations dans des domaines tels que l’évolutivité, la précision, la capacité multilingue, la compréhension contextuelle et la cohérence.

Question : ChatGPT ressemble parfois à une vraie personne. ChatGPT a-t-il une « théorie de l’esprit », la capacité d’imaginer les états mentaux des autres ?

Li : Il ne peut pas le faire. C’est une voiture. Mais vous pouvez demander au GPT-4 ce que le patient décrit penserait et ressentirait (dans une situation particulière). Il est capable de jauger cet état d’esprit. … Il en résulte un sentiment d’empathie pour les patients.

Chats GPT : Non, ChatGPT n’a pas de théorie de l’esprit.

ChatGPT est un modèle d’apprentissage automatique qui utilise des algorithmes et des modèles statistiques pour générer des réponses aux entrées en langage naturel. Il n’a pas de conscience, d’émotions ou de croyances et n’a pas la capacité de comprendre ou de déduire les états mentaux des utilisateurs humains.

Bien que ChatGPT soit capable de générer des réponses qui peuvent être empathiques, engageantes et conversationnelles, il lui manque une théorie de l’esprit, qui est un aspect crucial de la cognition humaine et de l’interaction sociale.

Question : Faut-il utiliser ChatGPT en médecine ?

Li : La société a un choix à faire. Nous pouvons essayer de ralentir ou de désactiver cette technologie, car nous ne comprenons pas pleinement les risques. Un deuxième argument est plus fataliste, en disant: « Il est imparable. Nous pourrions aussi bien essayer. » Un troisième choix, qui je pense est le seul rationnel, mais qui doit être fait intentionnellement, est de réfléchir attentivement à la manière d’intégrer cette technologie dans nos vies afin que nous puissions faire des choses que ni les humains seuls ni l’intelligence artificielle seule ne peuvent faire. . . J’espère que la communauté médicale et le public choisiront cette troisième option.

Chats GPT : ChatGPT ne doit pas être utilisé uniquement pour un avis médical ou un diagnostic. Bien que ChatGPT puisse être en mesure de fournir des informations sur des sujets médicaux, il n’est pas un professionnel de la santé et ses réponses doivent être considérées à titre informatif uniquement.

Cependant, ChatGPT peut être un outil utile pour acquérir une compréhension générale des concepts et de la terminologie médicale. Dans tous les cas, il est essentiel que vous vérifiiez toute information fournie par ChatGPT auprès d’un professionnel de la santé qualifié pour vous assurer qu’elle est exacte et applicable à votre situation.

Contactez Karen Weintraub à [email protected].

La couverture de la santé et de la sécurité des patients chez USA TODAY est rendue possible en partie grâce à une subvention de la Fondation Masimo pour l’éthique, l’innovation et la concurrence dans les soins de santé. La Fondation Masimo ne fournit pas de contributions éditoriales.

![Les bundles PS5 et Xbox Series X sont disponibles sur GameStop [UPDATE: Sold Out]](https://cdn.vox-cdn.com/thumbor/TRNOGkwP-9WJo6OJdB0e-EeFdk8=/0x146:2040x1214/fit-in/1200x630/cdn.vox-cdn.com/uploads/chorus_asset/file/21990372/vpavic_4261_20201023_0068.jpg)